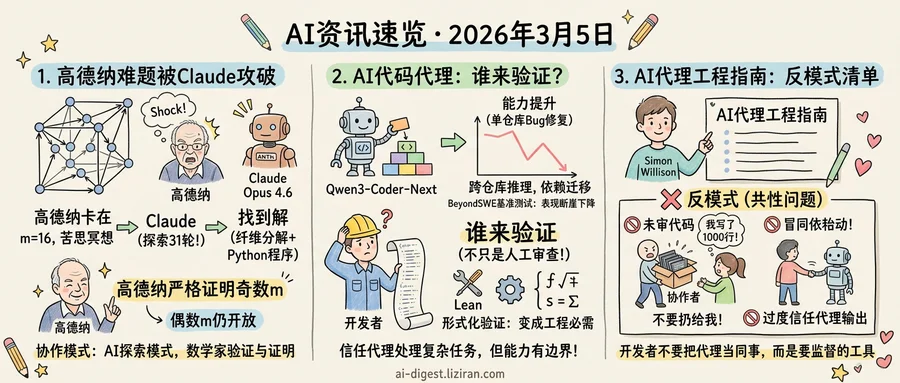

01高德纳的未解难题被Claude攻破,数学家与AI的新关系正在被改写

「Shock! Shock!」87岁的计算机科学家高德纳在斯坦福发出的这封短信,让整个数学社区为之一震。他花了数周研究的一个开放问题,刚被Anthropic的混合推理模型Claude Opus 4.6解决了。

这个问题来自高德纳正在撰写的《计算机程序设计艺术》新卷,涉及有向哈密顿圈的分解:给定一个由三维模运算构成的有向图,能否将所有弧分解为三个哈密顿圈?高德纳本人解决了m=3的情况,却卡在了一般化推广上。他的朋友Stappers接过挑战,用实验方法验证到m=16,但始终找不到通用构造。

Stappers决定把问题原封不动地交给Claude。接下来的过程值得细看:Claude先将问题重新表述为置换选择问题,然后尝试了暴力搜索、模拟退火、纤维分解等至少31轮探索。每一轮都按指令把进展写入计划文档,失败了就换方向。第15轮,它发现了一种「纤维分解」视角,把三维结构按坐标和的模投影到层状图上。第27轮接近成功,用循环坐标旋转构造出三个哈密顿圈,但仍有少量顶点冲突。第30轮,它回头审视之前模拟退火碰巧找到的一个解,从中注意到每层的选择只依赖单个坐标,由此在第31轮写出了一个Python程序,对所有奇数m都给出了完美分解。

Stappers验证了m=3到m=101的全部奇数情况,每一个都成功。但Claude的贡献止步于此——严格的数学证明由高德纳本人完成,他在论文中逐步推导了为什么这个构造确实生成长度恰好为m的三次方的圈。偶数情况至今仍是开放问题。

高德纳在论文中写道,这让他不得不「修正自己对生成式AI的看法」。但他同时强调,Claude在探索偶数情况时表现明显退化,Stappers不得不中止。这不是AI独立攻克数学的故事,而是一种新的协作模式:AI负责大规模算法探索和模式发现,数学家负责提炼、验证和证明。

02AI coding agent越来越能写,但「谁来验证」的问题越来越尖锐

阿里最新的Qwen3-Coder-Next只激活80B参数中的3B,就在主流代码基准上跑出接近旗舰模型的修复能力,证明小参数也能撑起强coding agent。

但BeyondSWE讲了另一个故事。这个覆盖500个真实案例的基准测试把评估从「单仓库bug修复」扩展到跨仓库推理、依赖迁移和整库生成,当前最强agent的表现断崖式下降。单仓库修复中得分亮眼的模型,碰上跨代码库理解依赖关系的任务,几乎完全失效。

矛盾在于:agent在简单任务上越来越可靠,开发者自然会信任它处理更复杂的任务,但能力边界不会提前通知你。定理证明工具Lean的创建者最近撰文直问:当AI写的代码越来越多,谁来验证?de Moura认为形式化验证将从学术课题变为工程必需品,用数学证明程序正确性,不再只属于航天和金融。

BeyondSWE的数据佐证了这个判断:agent不是在所有任务上「差一点」,而是在特定任务类型上完全失效,且失效模式不容易靠人工审查发现。

03Simon Willison发布AI agent工程指南,「反模式」清单直指行业共性问题

「不要把你没审过的代码扔给协作者。」独立开发者Simon Willison在最新发布的AI agent工程指南中,把这条列为首要反模式。他描述的场景在开发团队中已经越来越常见:有人用agent生成了几百甚至上千行代码,未经审查就提交了Pull Request,实际上是把验证工作转嫁给了队友。

这份指南在Hacker News上获得471票和274条评论,讨论热度本身说明了一个问题——AI agent工程目前没有行业标准,开发者在各自摸索中积累的经验碎片,正在充当事实上的规范。Willison的总结之所以引发关注,不是因为他说了什么新鲜事,而是因为他把很多人隐约感觉到但没有系统表达的实践问题写成了清单。

指南覆盖了agent工程的多个层面,但反模式部分最具实用价值。除了未审查代码的问题,他还警告了过度依赖agent输出、忽视上下文管理等常见陷阱。这些反模式的共同特征是:开发者把agent当成了可以完全信任的同事,而非需要持续监督的工具。

这种信任错位在个人项目中代价有限,但在团队协作中会迅速放大。一个人提交的未审查代码,消耗的是整个团队的审查资源和技术信任。当越来越多团队引入AI agent,「谁为agent生成的代码负责」正在从技术问题变成协作问题。

快影发布Kling-MotionControl,用统一DiT框架实现角色动画驱动 该框架采用分治策略,将异构运动信号(面部、身体、手部)统一处理,可从驱动视频中提取动态并迁移至参考图像,生成高保真角色动画。 huggingface.co

多模态预训练实验揭示:视觉扩散与语言预测可在同一框架内联合训练 研究团队采用Transfusion框架,对语言用next-token预测、对视觉用扩散模型,从零开始做受控预训练实验,系统隔离了影响多模态预训练效果的关键因素。 huggingface.co

PRISM引入过程奖励模型引导推理,缓解深度思考中的「越想越错」问题 现有深度推理框架在扩展推理步数时,常因缺乏正确性信号而放大错误、压制正确的少数解。PRISM通过过程奖励模型在推理过程中提供逐步校验,打破这一瓶颈。 huggingface.co

Utonia尝试用一个点云编码器覆盖所有领域 该模型在遥感、室外LiDAR、室内RGB-D、CAD模型和RGB视频提取的点云上统一做自监督预训练,尽管各领域的传感几何和密度差异极大,仍学到一致的表征。 huggingface.co

Image-CoT应用于图像编辑遇到三大挑战,新方法提出自适应推理时间分配 与文生图不同,图像编辑的解空间受源图和指令约束。研究发现固定采样预算在编辑任务中效率低下,提出自适应测试时缩放策略,按任务难度动态分配推理资源。 huggingface.co

Kiwi-Edit发布可扩展数据管线,解决参考图引导视频编辑的数据瓶颈 指令式视频编辑在精细视觉控制上受限于自然语言的表达能力,参考图引导是更好方案但缺乏训练数据。Kiwi-Edit构建了一条从现有编辑对中生成高质量配对数据的管线。 huggingface.co

InSight提出基于加权互信息的RL训练数据选择,替代「按难度选题」的粗放策略 现有强化学习数据筛选多依赖难度启发式,默认「中等难度=最有信息量」,忽略了样本量不足带来的认知不确定性。InSight用信息论方法重新定义数据价值。 huggingface.co

SteerEval基准测试LLM可控性:语言特征、情感和人格三个维度逐层评估 该基准将可控性分为「表达什么」「如何表达」「如何实例化」三个层级,覆盖语言特征、情感和人格三个领域,为评估LLM在社会敏感场景中的行为一致性提供统一框架。 huggingface.co

Mix-GRM将广度推理与深度推理解耦,提升生成式奖励模型评估可靠性 现有生成式奖励模型依赖无结构的链式推理扩展长度来提升效果,Mix-GRM将推理拆分为广度CoT(多维度原则覆盖)和深度CoT(实质性判断推导),分别优化后协同工作。 huggingface.co

UniG2U-Bench发布:系统测试「生成能力是否真的提升了理解能力」 统一多模态模型生成能力日益强大,但生成是否以及何时改善理解仍不清楚。该基准将生成到理解的评估分为7类30个子任务,要求不同程度的视觉变换能力。 huggingface.co