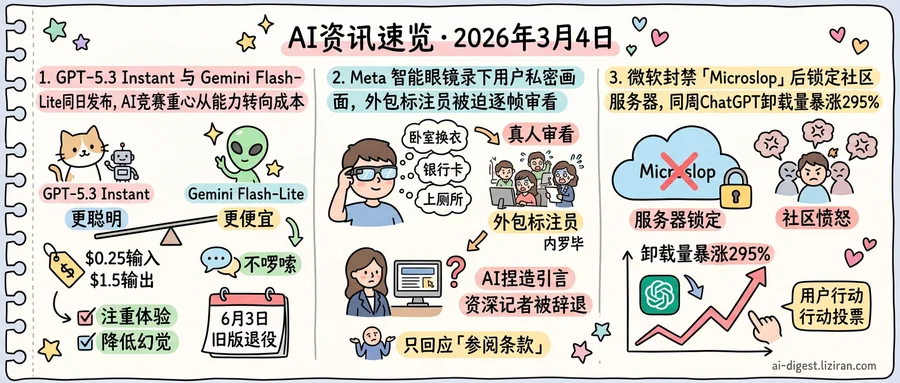

01GPT-5.3 Instant与Gemini Flash-Lite同日发布,AI竞赛重心从能力转向成本

3月3日,两家AI巨头几乎同时发了新模型,但两款产品的卖点都不是「更聪明」。GPT-5.3 Instant取代旧版,成为所有用户的默认对话模型,主打「更顺畅的日常对话」。同一天,谷歌发布了Flash-Lite,口号是「为规模化智能而生」。两家不约而同选了同一个方向,不追天花板,压地板。

Flash-Lite的定价是最直接的证据。每百万token输入0.25美元,输出1.5美元,只有谷歌自家旗舰模型的八分之一。技术博主Simon Willison算完账后指出,这个价格让大规模调用的成本几乎可以忽略。谷歌还给模型设了四档思考深度,开发者按需选择,用多少算力付多少钱。

GPT-5.3 Instant走的是另一条路:不谈价格,谈体验。新模型砍掉了多余的安全声明和说教式语气,在联网搜索场景下幻觉率比旧版降低了近27%。OpenAI称,旧版习惯用「冗长的安全前言」开头,新版则「直接进入回答」。这等于把产品线一分为二,聪明的留给高端推理模型,好用的交给Instant系列。

两家公司同一天瞄准了同一个方向,背后逻辑相通:模型能力差距在日常任务中越来越难被用户感知,竞争自然转向成本和体验。Flash-Lite用八分之一的价格争夺开发者。Instant则用「不啰嗦」来留住普通用户。OpenAI已宣布6月3日退役旧版。届时所有用户的默认对话模型,都将换成这款主打「好用」的Instant。

02Meta智能眼镜录下用户私密画面,外包标注员被迫逐帧审看

在内罗毕,Meta的外包标注员每天审看智能眼镜用户录下的视频:有人在卧室换衣服,有人露出银行卡,有人在上厕所。一名标注员对瑞典《每日新闻报》说:「你知道自己在看别人的私生活,但只能继续干。」另一人更直接:「开始问问题,你就走人。」

这些画面来自去年卖出的700多万副Meta智能眼镜(前两年合计仅200万副)。用户启用AI功能必须同意远程数据处理,但几乎没人知道画面会送到肯尼亚、哥伦比亚和印度由真人标注。一名标注员说,用户若了解实情,「根本不会按下录制键」。

记者就此向Meta求证,两个月没得到回应,最终只收到一句:数据处理「遵循服务条款」。

同一周,Ars Technica的一名资深AI记者也丢了工作。他赶稿时用ChatGPT整理素材,AI凭空捏造了一段引言,被他直接写进报道。事后他承认全部责任,说自己当时发着烧在床上赶稿。

两起事件里承担后果的都是具体个人。Meta对700万用户隐私质疑的全部答复,至今是一句「请参阅条款」。

03微软封禁「Microslop」后锁定社区服务器,同周ChatGPT卸载量暴涨295%

用户在微软的官方Discord社区里给自家AI助手起了个外号:「Microslop」。上周微软把这个词加进了自动过滤名单,包含它的消息直接被删除。

用户立刻开始用各种拼写变体绕过过滤,讨论热度不降反升。微软索性锁定了整个服务器,所有人都无法发言。这件事在Hacker News上拿到1150票和525条评论(技术社区中罕见的关注度),几乎一边倒地批评微软的做法。

锁服堵住了一个社区,但堵不住更大范围的用户行动。同一周,国防部合同消息公布后,ChatGPT的卸载量暴涨了295%。原因不同,模式一样:用户跳过抗议和请愿,直接用卸载和嘲讽投票。

两家公司的失误也如出一辙。微软把社区嘲讽当内容审核问题处理,审核本身却成了新的导火索,锁服更是把一个词的争议升级成了整个社区的愤怒。而295%的卸载数据同样说明,当商业决策触碰用户的价值底线,公关团队的反应速度根本追不上用户卸载的手速。

微软的Discord服务器至今仍处于锁定状态。

Google DeepMind发布Project Genie提示词指南 Google DeepMind公开了Project Genie的4条提示词技巧,帮助用户通过文字描述生成可交互的3D世界。 blog.google

SWE-rebench V2:首个多语言大规模软件工程任务集 该数据集覆盖多种编程语言,为软件工程Agent的强化学习训练提供可复现的执行环境和测试套件,解决了现有训练数据规模不足、语言覆盖单一的问题。 huggingface.co

开发者从零构建延迟低于500毫秒的语音Agent 一位开发者在Hacker News上展示了自研语音Agent,端到端延迟控制在500毫秒以内。 ntik.me

LLaDA-o:混合扩散架构统一多模态理解与生成 LLaDA-o采用「混合扩散」框架,用离散掩码扩散处理文本理解、连续扩散处理图像生成,两者共享注意力骨干网络以减少冗余计算,并引入数据驱动的长度自适应机制。 huggingface.co

OmniLottie:从文本和图片直接生成Lottie矢量动画 该框架将Lottie JSON格式参数化为紧凑token序列,去除冗余结构元数据,使多模态大模型能够根据文字或图片指令生成可编辑的矢量动画。 huggingface.co

CHIMERA:用紧凑合成数据提升LLM推理泛化能力 研究提出一套数据合成框架,针对推理训练中缺少长链思维轨迹、数据多样性不足、质量难以验证三个瓶颈,生成可直接用于SFT和RL后训练的推理数据集。 huggingface.co

CoVe:用约束验证框架训练多轮工具调用Agent CoVe先定义显式任务约束,再用这些约束同时引导数据合成和验证结果正确性,解决了工具调用训练数据既要复杂又要准确的矛盾。 huggingface.co

OpenAutoNLU开源:无需手动配置的NLU自动化训练库 该库覆盖文本分类和命名实体识别任务,内置数据感知的训练策略自动选择、数据质量诊断和分布外检测功能,支持低代码使用。 huggingface.co

WorldStereo:用3D几何记忆连接视频生成与场景重建 该框架在视频扩散模型中引入3D几何记忆模块,解决了生成视频在不同相机轨迹下内容不一致、难以重建3D场景的问题。 huggingface.co

Image-CoT方法适配图像编辑:自适应推理时间分配 研究指出图像编辑不同于文生图,解空间受源图和指令约束,固定采样预算会导致资源浪费。论文提出自适应测试时缩放策略,按编辑难度动态分配推理计算量。 huggingface.co