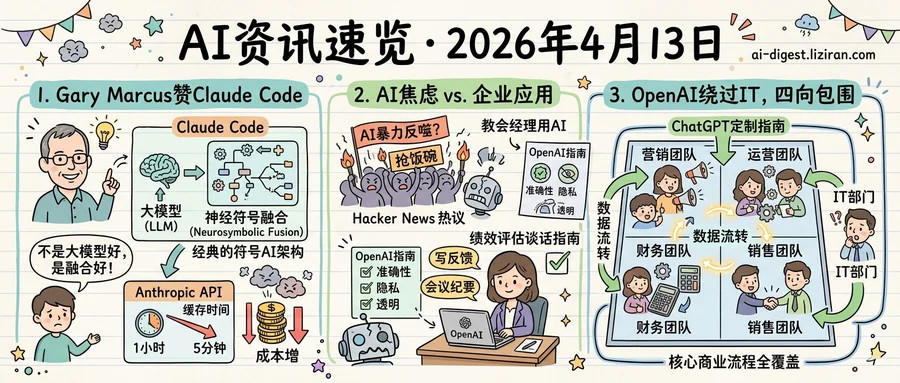

01批评深度学习25年的Gary Marcus,称Claude Code是大模型以来最大突破

Gary Marcus用整个职业生涯跟深度学习阵营打仗,从2001年出书到2019年公开辩论,二十多年论证纯神经网络走不远。本周他在博客里说了一句让很多人意外的话:Claude Code是大模型诞生以来最大的突破。

但他夸的不是大模型本身。这个工具好用,恰恰因为核心不是纯大模型。泄露的源代码中有一个3167行的关键模块,内含486个分支判断和12层嵌套,是经典的符号AI架构。在他看来,Anthropic在关键环节放弃了概率推理、转向确定性逻辑,走的正是他倡导25年的神经符号融合路线。

Marcus看到了产品的天花板。同一周,另一群用户正在感受地板的松动。

一位开发者贴出近12万条API调用的分析数据:3月6日起,缓存有效期从1小时被降回5分钟。离开键盘超过5分钟,整段对话上下文就过期,重新加载的成本是此前的12.5倍。按他的测算,用户总成本因此多出约17%。有人写道:「以前Pro订阅能用几小时才耗尽额度,现在20分钟就没了。」

Anthropic工程师回应称这是有意的「缓存优化」,理由是很多请求只调用一次,1小时写入费反而更贵。但开发者们不买账,要求把缓存时长的选择权交还用户。这条反馈最终被关闭,标记为「不予修复」。

02572条评论在争论AI会不会引发暴力,同一周OpenAI在教经理用AI写绩效评估

有人援引工业时代工人砸毁纺织机的历史,有人计算哪些白领行业最先被AI取代,也有人反驳这不过是又一轮技术恐慌。上周,一篇题为「AI将遭遇暴力反噬」的文章在Hacker News引发了这场争论,572条评论的讨论密度远超常规技术帖。文章的论点并不新鲜,但评论区的响应说明它触到了真实的焦虑。

同一个新闻周期,OpenAI发布了面向企业管理者的培训课程。课程教经理用ChatGPT准备绩效谈话、撰写反馈、整理会议纪要。配套的「负责任使用AI」指南把议题框定在操作层面:核查输出准确性,保护数据隐私。整套材料的预设很明确,企业采用AI已是既定事实,剩下的只是执行细节。

一边在认真讨论AI会不会引发社会冲突,另一边已经在教中层管理者用它写周报。OpenAI的指南列出了安全、准确性、透明度三项原则,岗位替代不在清单上。

03营销、运营、财务、销售同时收到ChatGPT定制指南,OpenAI跳过了逐部门渗透的老路

四份ChatGPT定制使用指南同时上线,分别面向营销、运营、财务、销售,每套按职能拆解了具体操作路径。四个部门加起来,就是一家中型企业除技术团队外的全部商业核心。

Salesforce花了数年才从销售部门扩展到其他团队。Slack走了类似的路,从工程团队起步靠口碑逐步渗透全公司。行业共识是先在一个部门站稳脚跟,OpenAI直接跳过了这步。

这套做法之所以能成立,是因为四份指南的读者不是开发者,而是营销经理、财务分析师、销售代表。OpenAI绕开了企业采购中通常要先过的IT部门,直接和业务线对话。

当多个部门同时上手,跨部门的依赖就开始形成。营销团队拿ChatGPT分析投放效果,产出直接喂给销售团队做客户研究,两条工作流开始交织。四份指南已全部上线,一家企业的核心商业流程从此可以全部跑在同一个工具上。