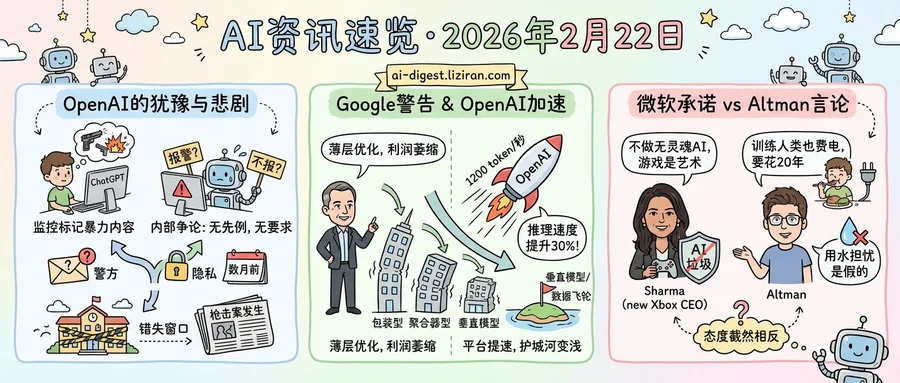

01OpenAI数月前发现枪手在ChatGPT上排演暴力,却在「要不要报警」中犹豫不决

去年六月,OpenAI内部的滥用监控工具标记了一组异常对话:一名用户在ChatGPT上反复描述枪击暴力场景,内容具体到触发了人工审核。几名员工查看记录后发出内部警告,认为这背后可能存在真实威胁。

公司内部随即围绕一个问题反复拉锯:要不要联系警方?对话内容足够具体,放任不管可能错失阻止暴力的窗口;但主动将用户私人聊天记录交给执法部门,在法律上没有依据,也没有先例。一旦判断失误,OpenAI就等于为整个行业开了口子,允许科技公司在认为用户「可能危险」时把聊天记录直接交给警察。没有法律要求他们必须上报,也没有行业惯例可循。争论就这么持续了数月。

那名被标记的用户叫Van Rootselaar,住在加拿大不列颠哥伦比亚省一个偏远小镇。在OpenAI内部争论未决的那几个月里,她在当地一所学校制造了大规模枪击事件。

事后,两家科技媒体的报道证实,OpenAI的监控系统早在去年六月就捕捉到了信号。但截至目前,美国和加拿大都没有法律要求科技公司在检测到用户潜在暴力倾向时通报执法部门。

02Google高管点名两类AI创业公司难以存活,同周OpenAI推理速度突破1200 token/秒

两类AI创业模式正被上下游同时挤压。Google一位副总裁上周公开警告:靠在大模型上做薄层优化的「包装型」公司,和靠整合多家模型做路由的「聚合器型」公司,利润空间在萎缩,差异化在消失。

这个警告发出的同一周,OpenAI将旗下编程模型的推理速度提升了30%,突破每秒1200 token。两件事讲的是同一回事:wrapper的卖点通常是「比原版快一点」或「便宜一点」,但平台自己把速度拉到这个水平,差价空间就被系统性压缩。聚合器的处境类似,当头部模型质量差距收窄,「帮你选最好的模型」本身就在贬值。

护城河建在别人的地基上,地基每升级一次,护城河就浅一层。要跳出这个循环,创业公司需要把壁垒锚定在自己控制的资产上:拥有垂直领域的模型,或积累平台拿不走的数据飞轮。

03微软游戏新CEO承诺不做「AI垃圾」,Altman称训练人类也很费电

微软游戏部门换帅,新CEO Sharma上任第一天就表态:「我们不会追求短期效率,不会让生态充斥无灵魂的AI垃圾。游戏永远是艺术,由人类创造。」

这番承诺的微妙在于Sharma的背景。她此前是微软CoreAI总裁,负责AI产品开发。让AI高管来承诺克制AI,是刻意的安排。但纳德拉过去对「AI slop」一词明确表示过不满,这位新CEO却主动接过了批评者的措辞。

同一天,Altman在《印度快报》的活动上被问到AI能耗。这位OpenAI掌门人的回应是:「训练一个人类也要大量能源,要花20年,吃掉那些年所有的食物。」他还称AI用水量的担忧「完全是假的」。

微软向OpenAI投入了超过130亿美元,两家AI战略深度绑定,面对公众质疑的姿态却截然相反。而Sharma接替的,是在微软待了38年的游戏老将Spencer。

Karpathy提出「Claws」概念:LLM agent之上的新抽象层 Andrej Karpathy发文称「Claws」是LLM agent之上的新层,将编排、调度、上下文和持久化从agent中抽离出来。他买了一台Mac Mini来本地运行OpenClaw,但表示对其安全性「有点警觉」。 simonwillison.net

Arcee发布Trinity Large:400B参数MoE,每token激活13B Arcee公开Trinity系列技术报告。旗舰Trinity Large总参数400B,每token激活13B,架构包含交错局部/全局注意力、门控注意力和sigmoid路由。同期发布6B(激活1B)和26B(激活3B)两个小型版本。 huggingface.co

前沿AI风险管理框架更新至v1.5 该框架对前沿AI模型进行五个维度的风险评估,覆盖网络攻击、说服与操纵等领域,本次更新针对大模型能力演进和agentic AI扩散做了更细粒度的分析。 huggingface.co

开发者讨论Claude桌面端为何选择Electron 开发者Drew Breunig撰文分析Anthropic的Claude桌面应用为何采用Electron框架,文章在Hacker News引发讨论。 dbreunig.com

论文提出LLM agent的成本感知探索策略 「Calibrate-Then-Act」研究LLM agent在交互式任务中如何权衡探索成本与不确定性,例如生成代码后是否值得写测试来验证正确性,而非直接提交答案。 huggingface.co

研究对比车载AI agent的中间反馈策略 一项45人实验对比了车载LLM助手在多步任务中实时展示进度与仅给出最终回复两种模式,聚焦驾驶等注意力敏感场景下agentic AI的用户体验。 huggingface.co