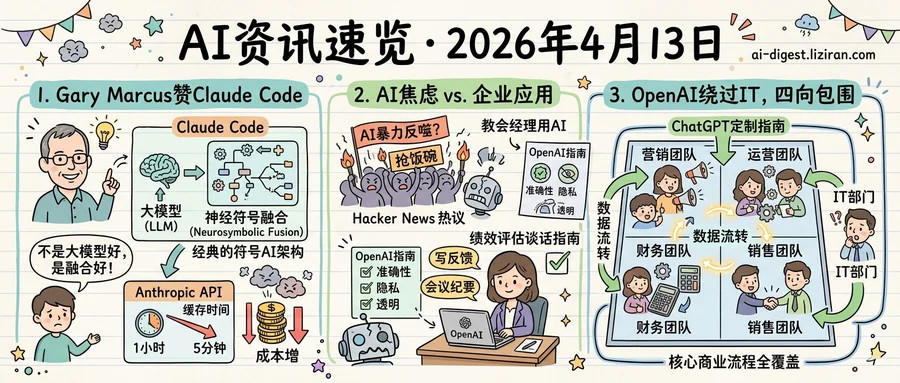

01写了25年AI批评的Marcus称Claude Code是「最大突破」,同月缓存有效期从1小时降到5分钟

AI领域最知名的怀疑论者Gary Marcus上周在博客中为一款产品破了例。他称Claude Code是「LLM以来最大的突破」,这在他25年的批评生涯中极为罕见。

让他改口的不是模型变大了。他拆解了Claude Code的核心代码,找到一个3167行的确定性内核,486个条件分支,12层嵌套的if-then逻辑。在他看来,Anthropic实质上承认了纯LLM「太随机、太不稳定」,转向了他倡导25年的神经符号主义路线。他仍说这个产品「远谈不上完美」,但方向对了。

但同一个月,开发者看到的是另一面。3月6日起,Anthropic将缓存有效期从1小时降到5分钟。一位开发者分析了近12万次API调用的账单:2月浪费率1.1%,3月跳到25.9%。缓存写入成本是读取的12.5倍,session中断超过5分钟,就要按写入价格重建全部缓存。四个月里,仅这一位用户就多付了949美元。

这条issue在Hacker News上获得458个点赞。Anthropic工程师回应称调整是「有意的缓存优化」,1小时有效期对单次请求反而更贵。但长时间使用Claude Code的重度开发者受冲击最大,多名订阅用户报告3月起首次撞上5小时配额上限。目前Anthropic没有公布恢复长缓存的计划。

02预言「AI将遭遇暴力」的文章收获572条讨论,焦虑的是AI从业者自己

「AI将遭遇暴力,且不会有好结果。」一篇以此为标题的长文上周登上Hacker News热榜,收获324票和572条评论,评论量远超同期多数技术帖。

参与讨论的不是反科技活动人士。Hacker News以开发者和创业者为主,其中不少人正在构建AI产品。这篇文章讨论的恰恰是这些产品可能引发的社会冲击。

几乎同一时间,OpenAI发布了一份「负责任使用AI」指南,内容覆盖准确性、透明度和安全操作,全部聚焦个人层面的最佳实践。指南回应的是「怎么正确使用AI」,而开发者社区此刻追问的是「AI正在对社会做什么」。

这份指南没有任何章节涉及就业冲击或社会结构变化。

03同一天给四个企业部门各发定制课程,OpenAI在用Salesforce的方法卖AI

四门课对准四个企业职能部门,同一天上线。OpenAI在线学院的最新课程不按功能划分,而是按营销、运营、财务、客户成功四条业务线组织。营销课教活动规划,财务课聚焦报表预测,客户成功课讲续约和流失预防。

卖点不是「ChatGPT能做什么」,而是「你今天的工作怎么用它重做」。这套打法有现成模板。Salesforce靠免费认证体系让用户在学习中把工作流和产品绑死。HubSpot用同样的逻辑把培训变成获客通道。两家证明:当用户通过课程学会一套工作方法,迁移成本就不只是功能对比,而是肌肉记忆的重建。

按部门划分,每个决策者都能找到「跟我有关」的入口,不需要先懂底层技术。当财务团队习惯了用ChatGPT出月度报表,换工具的阻力就从技术评估变成了日常惯性。

白宫官员私下推动银行测试Anthropic Mythos模型 据TechCrunch报道,特朗普政府官员正鼓励银行试用Anthropic的Mythos模型——而国防部此前刚将Anthropic列为供应链风险。 techcrunch.com

跟踪骚扰受害者起诉OpenAI,称ChatGPT助长施害者妄想 原告称其前男友利用ChatGPT强化跟踪骚扰行为,OpenAI在收到三次警告——包括自身系统标记的大规模伤害风险——后仍未采取行动。 techcrunch.com

Anthropic临时封禁OpenClaw创建者的Claude访问权限 封禁发生在Claude上周对OpenClaw用户调整定价之后。 techcrunch.com

Valve泄露文件显示Steam正开发AI驱动的安全审核系统「SteamGPT」 泄露文件指向一套AI审查工具,用于帮助审核人员筛查大量可疑事件。 arstechnica.com

Apple正在测试四种智能眼镜设计方案 这批眼镜比此前规划的混合现实和增强现实设备系列更为收敛,定位更接近日常佩戴场景。 techcrunch.com

HumanX大会上Claude成为最热门话题 在旧金山举办的这场AI行业会议上,Anthropic是全场关注焦点。 techcrunch.com

Gallup报告:Z世代对AI日益幻灭,但停不下来 基于近1600名14至29岁美国受访者的调查显示,随着AI更深嵌入学习和工作,这一代人的热情正在消退,使用率却未下降。 theverge.com

AI模型预测英超赛果全面翻车,Grok表现最差 Google、OpenAI、Anthropic和xAI的模型均在英超比赛预测中大幅失准,xAI的Grok垫底。 arstechnica.com