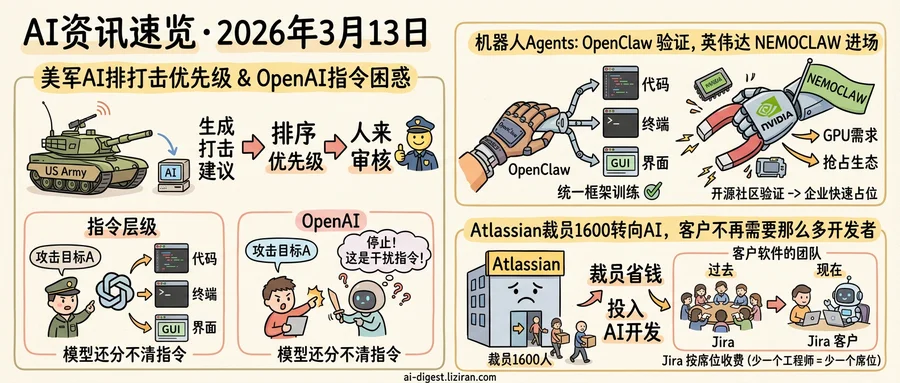

01美军要让AI排打击优先级,同周OpenAI承认模型还分不清该听谁的指令

一名美国国防官员本周透露,军方正在考虑用生成式AI对打击目标排序,由AI推荐优先级,再交人类审核。这是美军首次公开描述生成式AI在目标决策中的具体角色。

同一周,OpenAI连发两篇安全研究,讨论的恰好是这类系统最基础的问题:模型能否分清哪条指令该听、哪条该忽略。

第一篇聚焦prompt injection防御,描述了约束高风险操作、保护敏感数据的方案。第二篇提出IH-Challenge训练方案,专门解决「指令层级」问题:当来自不同来源的指令互相矛盾,模型该优先执行哪一条。这是当前大模型最顽固的安全短板之一,训练目标是让模型学会区分可信指令与不可信指令。

军方的流程里有人类审核环节,但审核有个前提:AI给出的排序基于对指令的正确理解。如果模型本身还在学习「该听谁的话」,审核员面对的就不是可靠系统的输出,而是一个可能因指令混淆而跑偏的建议。

国防官员没给出部署时间表,OpenAI也没宣布问题已解决。建造这些系统的公司还在发论文研究怎么让模型正确执行指令,打算部署的机构已经在讨论把它们放进打击决策链。

02OpenClaw刚验证机器人agent可训练,Nvidia带着NemoClaw进场抢生态

一篇叫OpenClaw-RL的论文刚证明,机器人agent可以用统一框架来训练:对话、终端操作、GUI交互产生的所有信号都能直接作为强化学习的训练源。赛道的技术可行性算是被验证了。

几天后,Nvidia宣布将开源自己的机器人agent框架,直接对标。这个框架叫NemoClaw,已在接触企业合作伙伴,计划赶在GTC大会前后推出。

时机不是巧合。Nvidia的扩张遵循一条逻辑:哪个软件层能创造GPU购买需求,就进入哪个软件层。之前是语言模型,通过投资开放权重模型让更多团队训练和部署,消耗更多算力。现在轮到机器人agent。赛道刚被验证走得通,Nvidia立刻带着企业资源入场。

这是它的一贯打法:让开源社区承担早期验证的风险,等信号明确,再用企业合作网络快速占位。对OpenClaw团队来说,最大的对手不是另一个研究组,而是自己的芯片供应商。

03Atlassian裁员1600人转向AI,做Jira的公司发现自己的客户不再需要那么多开发者

Atlassian靠一个前提赚钱:软件团队人多,协作需求就大,按席位收费的工具就卖得好。上周这家公司裁掉了1600人,约占员工总数的15%,管理层称裁员是为了将资源集中到AI产品上。

裁员的背景不只在公司内部。乐天最近公开了接入Codex的成果:这家日本电商巨头的工程团队故障修复时间缩短了一半,代码审查交给agent自动处理,原本耗时数月的全栈项目几周就能交付。这些不是概念验证,是生产环境里跑着的流程。

agent接管审查、修复、测试这些过去需要多人协作的环节之后,团队自然缩编。这家公司拿裁员省下的钱投入AI开发,但它的客户也在用这类工具缩减工程团队。Jira按席位收费,每减少一个工程师,就少一份订阅收入。

Anthropic向Claude Partner Network投资1亿美元 Anthropic设立1亿美元基金,投资围绕Claude构建产品和服务的合作伙伴网络。 anthropic.com

InternVL-U发布:40亿参数的统一多模态模型兼顾理解、推理、生成与编辑 InternVL-U采用模态专用模块设计与解耦视觉表征,在40亿参数规模下同时实现语义理解和内容生成能力。 huggingface.co

Omni-Diffusion用masked离散扩散替代自回归架构做多模态理解与生成 研究将离散扩散模型应用于多模态大语言模型,替代传统自回归架构,在视觉理解和图像生成任务上验证了这一路线的可行性。 huggingface.co

Flash-KMeans将经典k-means改造为GPU上的在线计算原语 研究指出现有GPU版k-means的瓶颈在底层系统约束而非算法本身,优化后可作为在线系统的一等组件使用。 huggingface.co

MIT Technology Review:AI正渗透到汽车、家电和医疗设备的工程设计流程 产品工程师越来越多地使用AI增强、验证和简化实体产品的设计,应用范围从汽车到维生医疗设备。 technologyreview.com

几何引导的强化学习实现多视角一致的3D场景编辑 研究利用「3D一致性易于验证」这一特性,将强化学习引入2D扩散模型驱动的3D编辑,解决多视角编辑结果不一致问题。 huggingface.co